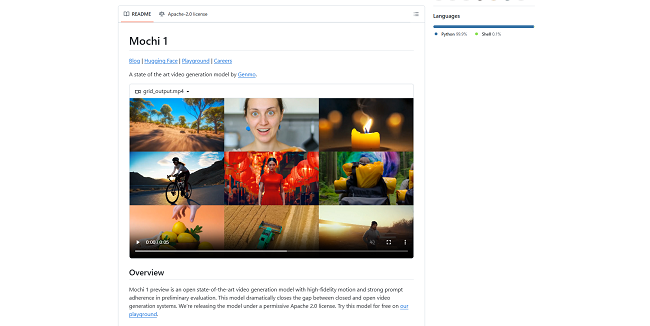

Mochi 1模型:高质量AI文生视频的开源选择

Mochi 1模型是基于DIT架构开发的顶尖开源AI文生视频生成模型,以卓越的生成一致性、细节处理和色彩表现广受关注。

Mochi 1在AI视频生成质量方面达到商用级模型标准,同时支持本地部署,使得该模型在性能和灵活性上都极具竞争力。本文将介绍Mochi 1的安装配置指南、优势特点和具体应用,帮助您更好地了解和使用这一强大工具。

Mochi 1模型的核心优势:一致性与细节表现

Mochi 1模型在AI文生视频领域表现出色,特别是在人物、色彩和细节一致性方面。无论是复杂场景的构建,还是精细特写的呈现,Mochi 1均能达到高质量效果,适合多种视频内容需求。

一致性出色的人物与细节生成

Mochi 1的生成一致性确保了人物特征、色彩和细节的一致性,这在文生视频模型中尤为难得。其精细处理使生成效果趋于自然,适合多种应用场景。

媲美商用级别的开源模型

Mochi 1不仅具备开源优势,同时在生成质量上接近商用级模型。这款模型支持多种本地部署配置,为内容创作者提供了高效、可靠的视频生成选择。

Mochi 1模型的安装与配置指南

Mochi 1模型支持多显卡配置,使得其应用场景更为广泛。尽管其原始需求较高,开源社区的持续优化已降低了硬件门槛,为普通用户提供了更灵活的配置方案。

硬件要求与显卡选择

Mochi 1原始模型需要四块H100显卡支持高显存,但目前已优化为可在单卡(如12G的3060显卡)运行,适用于个人及小型团队。

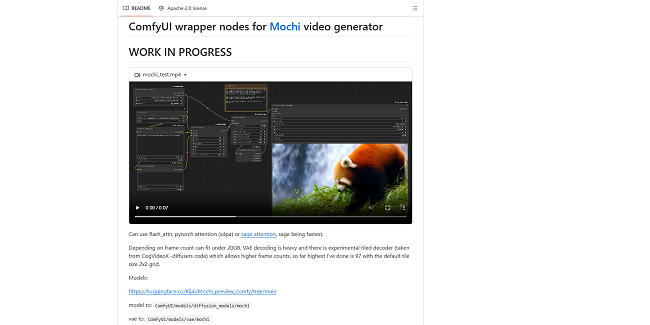

ComfyUI扩展的支持与简便安装

ComfyUI扩展(ComfyUI-MochiWapper)大大简化了Mochi 1的安装流程。只需克隆模型并配置显卡,即可在低于20G显存的环境中顺利运行。简单几步即可完成安装,用户可在短时间内开始文生视频。

生成效果优化建议:提升视频质量的小技巧

根据具体生成需求调整提示词和模型参数,可以提升Mochi 1生成的画面质量和一致性。这些技巧帮助优化生成效果,满足不同视频场景的定制化需求。

提示词的调整与自定义

为了达到最佳生成效果,可以针对生成对象设置更详细的提示词,例如复杂的描述词组或背景设置。Mochi 1支持正向和反向提示词,通过组合不同的提示词来实现个性化的视频效果。

CFG参数和分辨率优化

在生成过程中调高CFG参数(建议5.0至5.5之间)可以提升细节清晰度,同时在帧数与分辨率上做微调,能够平衡显存需求与效果表现。例如,保持较高的帧数但降低分辨率适合生成自然场景。

Mochi 1模型的应用场景:不同类型生成效果展示

Mochi 1模型在多个场景测试中均表现出色,包括动物、景物和人物等细节丰富的场景。这些生成场景展示了模型在不同风格和内容需求中的灵活性。

景物和自然场景效果

在测试中,Mochi 1模型能够轻松生成自然景物场景,如动物、森林、草原等画面,并准确表现光影细节。模型对色彩的细致处理使生成视频更具真实感和视觉吸引力。

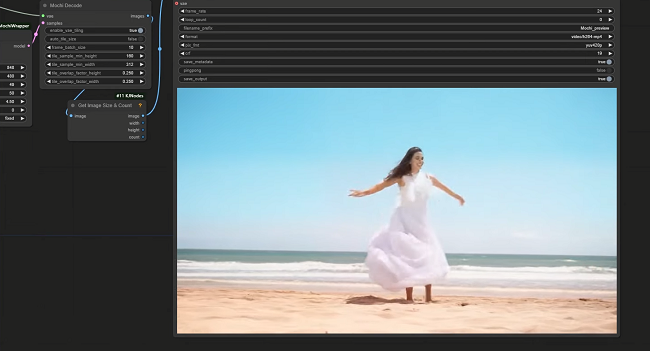

人物生成和动作场景测试

在动态人物生成方面,Mochi 1也表现良好,能够生成动作流畅且构图一致的人物场景,尽管某些特定场景中还存在轻微细节问题。

Mochi 1的未来发展:社区支持与功能拓展

在开源社区的支持下,Mochi 1模型持续获得优化和更新,未来或将支持更广泛的量化模型和更多高级功能,进一步提升模型的适用性与运行效率。

开源社区的持续支持与更新

Mochi 1在开源社区的推动下不断更新,通过优化量化模型和增加不同版本适配性,为用户提供更丰富的模型选择和灵活的本地化部署方案。

AI文生视频的未来发展潜力

随着AI文生视频的持续创新和发展,Mochi 1将成为视频创作者的得力助手。其出色的生成质量、开源性质和广泛适用性为未来的视频生成提供了强有力的支持。

总结

Mochi 1模型作为基于DIT架构的开源AI文生视频模型,以其卓越的一致性、细节处理和色彩呈现,为视频生成提供了强大支持。其支持的多种配置与优化方案,为不同用户提供了灵活选择。尽管安装和配置可能需要一定的技术基础,但通过社区优化后,Mochi 1已具备较高的易用性。未来,Mochi 1将进一步扩展功能和适用性,为视频创作开辟更多可能性。