AI图像局部重绘利器:ControlNet Inpaint模型详解

AI图像生成技术的快速发展带来了众多创新工具,其中,ControlNet Inpaint模型凭借强大的局部重绘能力备受瞩目。与传统的Flux模型相比,ControlNet Inpaint模型在图像修复和细节补充方面表现出色,能帮助用户快速修复图像中的缺陷。

ControlNet Inpaint模型与Flux模型对比

在AI图像局部重绘领域,ControlNet Inpaint模型的推出为创作者提供了更高效、精准的选择。相比之下,传统的Flux模型虽然在基础功能上能够实现图像的局部修改,但在细节处理和画面自然度方面稍显不足。ControlNet Inpaint模型通过改进算法和深度学习技术,使得图像修改更加细腻流畅,尤其适合于复杂场景的处理。

Flux模型的局部重绘局限性

Flux模型支持基础的局部重绘,但其生成的效果在细节和准确度方面较弱。当需要替换某些特定的图像元素时,Flux往往会出现边界不够自然或细节失真的问题。

ControlNet Inpaint模型的图像修复优势

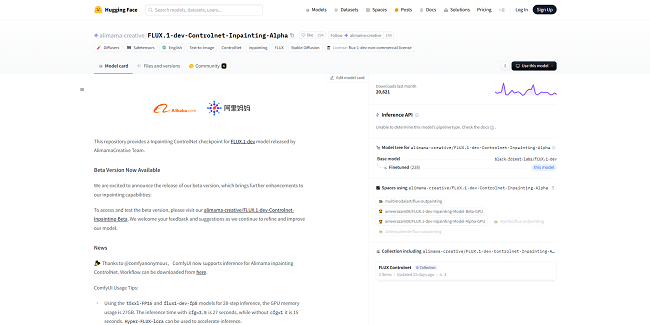

阿里巴巴推出的ControlNet Inpaint模型弥补了Flux的局限性,能够通过细致的控制网络对图像进行精准修改。无论是面部替换、背景填充,还是对人物的服饰或周围场景的细节修复,ControlNet都能带来更真实的视觉效果。

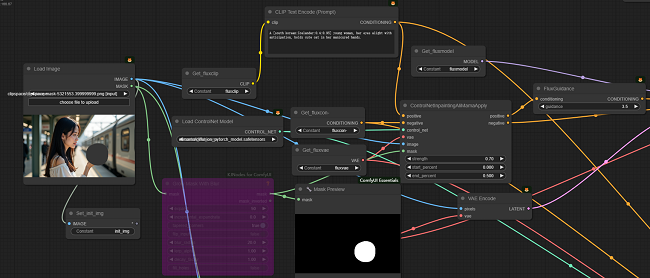

ComfyUI中ControlNet Inpaint模型的安装与使用

在ComfyUI中安装和使用ControlNet Inpaint模型相对简便,不需要额外安装扩展库。该模型可以通过ComfyUI的ControlNet文件夹加载,直接应用于局部重绘。

安装步骤

1. 从官网下载ControlNet Inpaint模型。

2. 将模型文件移动至ComfyUI的ControlNet文件夹中。

3. 打开ComfyUI,在界面中选择该模型进行加载。

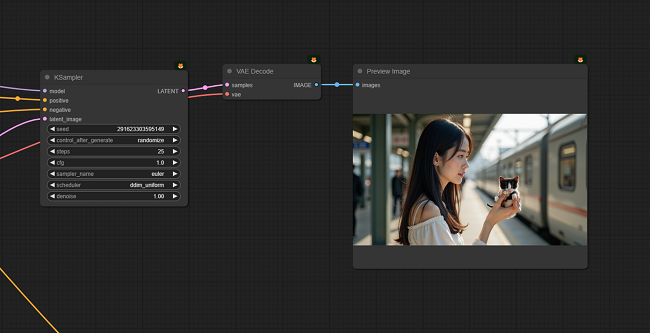

使用设置与参数调整

在使用过程中,ControlNet Inpaint模型的效果与参数设置密切相关。建议将图像分辨率适当提高,同时根据需求调整引导值为0.5到0.7,以保证局部绘制效果。这样可以避免生成效果不佳的情况,使局部细节更加清晰。

提示词与遮罩的使用技巧

提示词和遮罩的正确使用在AI局部重绘中至关重要。准确的提示词和合理的遮罩设置有助于生成更为自然的图像效果,避免出现模糊、失真或不合理的画面。

提示词的最佳实践

在ControlNet Inpaint模型中,详细的提示词能有效提升生成效果。建议用户在描述图像细节时加入特征性关键词,如颜色、材质、位置等,以便模型更好地理解场景需求。例如,对于想要生成的宠物或物体,可以使用具体描述而非单一词语。

遮罩的绘制技巧

遮罩的精确绘制也是提升图像效果的关键。建议遮罩的大小覆盖需要重绘的完整区域,避免在物体边缘处截断。这样可以确保模型在图像边缘处理时更加自然流畅,从而生成出无缝衔接的局部重绘效果。

ControlNet Inpaint模型的多场景应用

ControlNet Inpaint模型的多样化应用场景让其在图像修改和生成方面极具优势。无论是人像替换、物品补充还是场景修复,该模型都能够生成逼真且细腻的图像效果。以下将介绍该模型在各类场景中的具体应用方法。

人像替换与面部修复

在人像替换或修复应用中,ControlNet Inpaint模型能够精准替换面部元素,并实现自然的边缘处理。例如,可以将人物的脸替换为名人或虚拟形象,使图像既保持真实性,又富有创意。

场景补充与物品替换

在复杂场景的补充和物品替换方面,ControlNet Inpaint模型同样表现出色。通过多层遮罩和控制网络的支持,模型可以实现物品的无缝替换,生成与原图无异的效果,确保图像整体的自然协调。

总结

ControlNet Inpaint模型在AI局部重绘中提供了强大而灵活的解决方案,通过改进算法和优化操作流程,使得图像修改更加自然。无论是对参数设置的精细调控,还是提示词和遮罩的准确使用,ControlNet Inpaint模型都展现出卓越的生成效果。借助ComfyUI的集成功能,用户能够快速上手,在人像、物品和复杂场景的修改中实现更高质量的图像生成。