動画プロンプトの「無理ゲー」を突破する

動画のプロンプトって、何をどう書いたらいいか難しくないですか? 画面の細かい動きや構図を、文字だけでAIに伝えるのは、そもそも限界があると思いませんか?

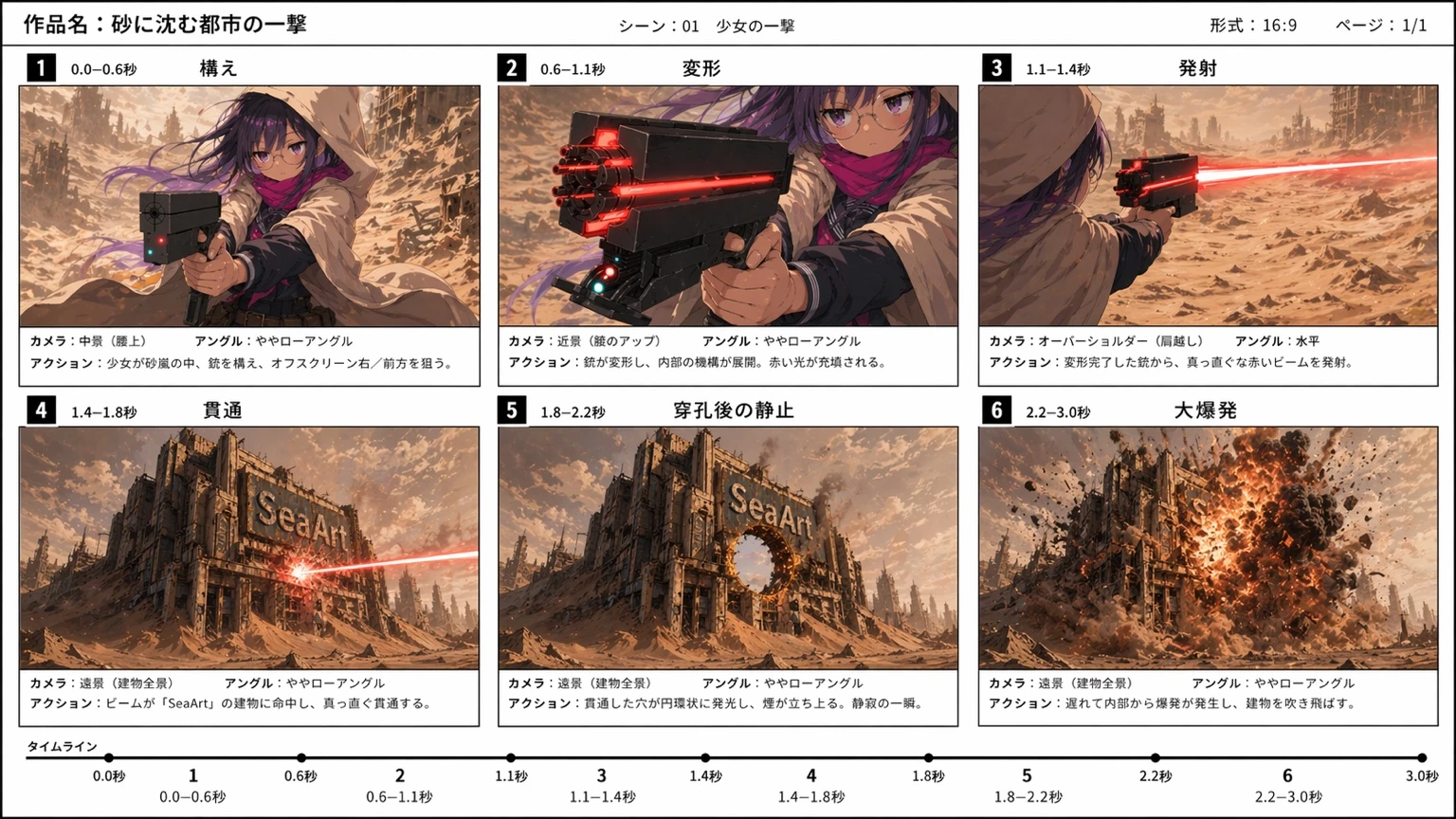

今回は、試行錯誤の中で見つけた「AIに文字で説明するのをやめる」画期的な方法をご紹介します。これは、最新モデルであるseedance 2.0の圧倒的な理解力にフルコミットしたやり方です。

「めんどくさい」から生まれた新手法

もともとは、「絵コンテを作成し、各シーンの画像を用意してリファレンス(参照)に使うと、思い通りの動画になる」という手法を試そうとしたのがきっかけでした。

ところが、いざ実践しようとすると大きな壁が。

- GPT image 2.0で絵コンテを作る。

- その各コマをバラして拡大する。

- さらに、それぞれのシーンに動画用のプロンプトを添える……。

……いや、超めんどくさい!!

10秒のワンカットならまだしも、少し長めの動画を作ろうとすると、作業量の多さに心が折れそうになります。そこで、ダメ元でこう考えました。

「この絵コンテのシート、そのまま放り込んだらどうなるんだ?」

奇跡の1行プロンプト

どうせ失敗するだろう、使える部分を切り取れればラッキー……くらいの気持ちで、参照画像に「絵コンテの画像1枚」をセット。

プロンプトは、これだけです。

"画像1の絵コンテに沿う動画を作ってください"

結果、出力されたのは……なんとほぼ完璧に構成されたタイトル画面の動画でした! seedance 2.0の理解力、正直ヤバすぎます。

成功率を上げる「ちょっとした工夫」

最初の1行だけでも驚きの結果でしたが、さらに精度を高めるためのコツも見つけました。 現在は、絵コンテに加えて「キャラクターの固定」を行っています。

- 参照画像2: 主人公の少女の見本

- 参照画像3: 破壊される建物の見本

このように素材をアップして、 「画像2は主人公の少女、画像3は建物の参考画像です」 と添えてあげるだけ。

これで、最初のプロンプトで起きがちだった「キャラの見た目が変わる」というランダム要素が抑えられ、成功率が劇的にアップしました!

結論:動画のキモは「絵コンテ」にあり

この手法の最大のメリットは、「動画生成の前に、ある程度どんな絵になるか(絵コンテで)視覚的に確定させておけること」です。そして、それを正確に解釈してくれるseedance 2.0の実力があってこそ成立します。

絵コンテ自体は、GPT image 2やnanobananaを使えば生成可能です。 ここが動画の完成度を左右する「設計図」になるので、ここだけは妥協せずに作り込みましょう!

人間でも文字で説明されるより、絵で教えてもらった方が圧倒的にわかりやすいですよね。

文字で格闘する時代は、もう終わったのかもしれません。